A integração de modelos, especialmente entre modelos linguísticos de grande escala (LLMs), apresenta um desafio interessante que aborda a necessidade crescente de sistemas de IA heterogêneos. Estes modelos têm frequentemente capacidades especializadas, como o multilinguismo ou conhecimentos especializados em domínios específicos, tornando a sua integração crítica para a criação de sistemas robustos e multifuncionais. No entanto, a integração bem-sucedida de LLMs não é uma tarefa fácil; muitas vezes requer conhecimentos intensivos e recursos computacionais significativos para equilibrar diferentes métodos de treinamento e processos de programação de forma eficiente, sem degradar o desempenho geral. Para simplificar este processo e reduzir a complexidade associada às atuais técnicas de integração de modelos, os investigadores estão a esforçar-se para desenvolver métodos de integração flexíveis e eficientes em termos de recursos.

Pesquisadores da Arcee AI e Liquid AI propõem um novo método de fusão chamado Differentiable Adaptive Merging (DAM). O DAM visa resolver a dificuldade de integração de modelos de linguagem, fornecendo uma abordagem eficiente e flexível que reduz a sobrecarga computacional normalmente associada aos processos de integração atuais. Especificamente, o DAM fornece uma alternativa para métodos complexos, como agrupamento evolutivo, melhorando a integração do modelo por meio de coeficientes de escala, permitindo agrupamento simples, mas eficiente, de múltiplos LLMs. Os pesquisadores também realizaram uma análise comparativa do DAM com outros métodos de integração, como DARE-TIES, TIES-Merging, e métodos mais simples, como Model Soups, para destacar seus pontos fortes e limitações.

O núcleo do DAM é sua capacidade de combinar vários LLMs usando uma abordagem baseada em dados, que envolve aprender os coeficientes de escala corretos para a matriz de peso de cada modelo. Este método é aplicado a várias partes de modelos, incluindo camadas verticais, camadas de incorporação e camadas de normalização de camadas. O DAM funciona ponderando cada coluna das matrizes de peso para equilibrar os recursos de entrada de cada modelo, garantindo assim que o modelo combinado retenha a força de cada modelo contribuinte. A função objetivo do DAM inclui várias partes: redução da diferença de Kullback-Leibler (KL) entre o modelo combinado e os modelos individuais, perda de similaridade de cosseno para promover variação nos coeficientes de escala e normalização de L1 e L2 para garantir mínimo e estabilidade durante treinamento. Esses elementos trabalham em conjunto para criar um modelo integrado robusto e bem integrado que pode lidar com uma variedade de tarefas de forma eficaz.

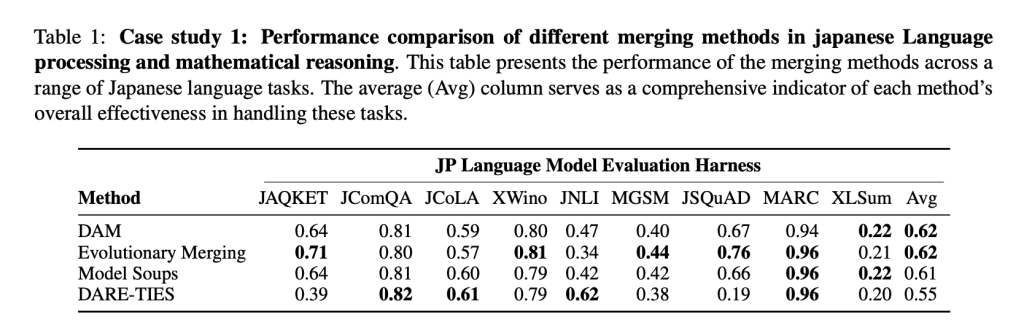

Os pesquisadores conduziram extensos experimentos para comparar o DAM com outros métodos de integração de modelos. Os testes foram realizados em diferentes famílias de modelos, como o Mistral e o Llama 3, e envolvem a combinação de modelos com diferentes habilidades, incluindo processamento multilíngue, conhecimento de codificação e raciocínio matemático. Os resultados mostraram que o DAM não apenas corresponde, mas, em alguns casos, supera técnicas populares como Evolutionary Merging. Por exemplo, em pesquisas focadas no processamento da língua japonesa e no raciocínio matemático, o DAM demonstrou alta flexibilidade, equilibrando com sucesso as habilidades especiais de diferentes modelos sem os requisitos computacionalmente intensivos de outros métodos. O desempenho foi medido usando múltiplas métricas, com o DAM geralmente pontuando tão alto ou no mesmo nível de outras medidas em tarefas que envolvem compreensão de linguagem, raciocínio matemático e processamento estruturado de perguntas.

O estudo conclui que o DAM é uma solução eficaz para integração de LLMs com custos computacionais reduzidos e intervenção manual. Este estudo também enfatiza que métodos complexos de agrupamento, embora poderosos, nem sempre superam alternativas mais simples, como a regressão linear, quando os modelos compartilham características comuns. O DAM prova que focar na eficiência e na escalabilidade sem sacrificar a funcionalidade pode proporcionar benefícios significativos no desenvolvimento de IA. No futuro, os investigadores pretendem testar a escalabilidade do DAM em diferentes domínios e linguagens, aumentando potencialmente o seu impacto no campo mais amplo da IA.

Confira Papel. Todo o crédito deste estudo vai para os pesquisadores deste projeto. Além disso, não se esqueça de nos seguir Twitter e junte-se ao nosso Estação telefônica de novo LinkedIn Gracima. Se você gosta do nosso trabalho, você vai gostar do nosso jornal.. Não se esqueça de participar do nosso Mais de 50k ML SubReddit.

[Upcoming Live Webinar- Oct 29, 2024] Melhor plataforma para modelos ajustados: mecanismo de inferência Predibase (avançado)

Sana Hassan, estagiária de consultoria na Marktechpost e estudante de pós-graduação dupla no IIT Madras, é apaixonada pelo uso de tecnologia e IA para enfrentar desafios do mundo real. Com um profundo interesse em resolver problemas do mundo real, ele traz uma nova perspectiva para a intersecção entre IA e soluções da vida real.